AI Companion กฎหมายต้องไปทางไหน? สิทธิและความรับผิดชอบ

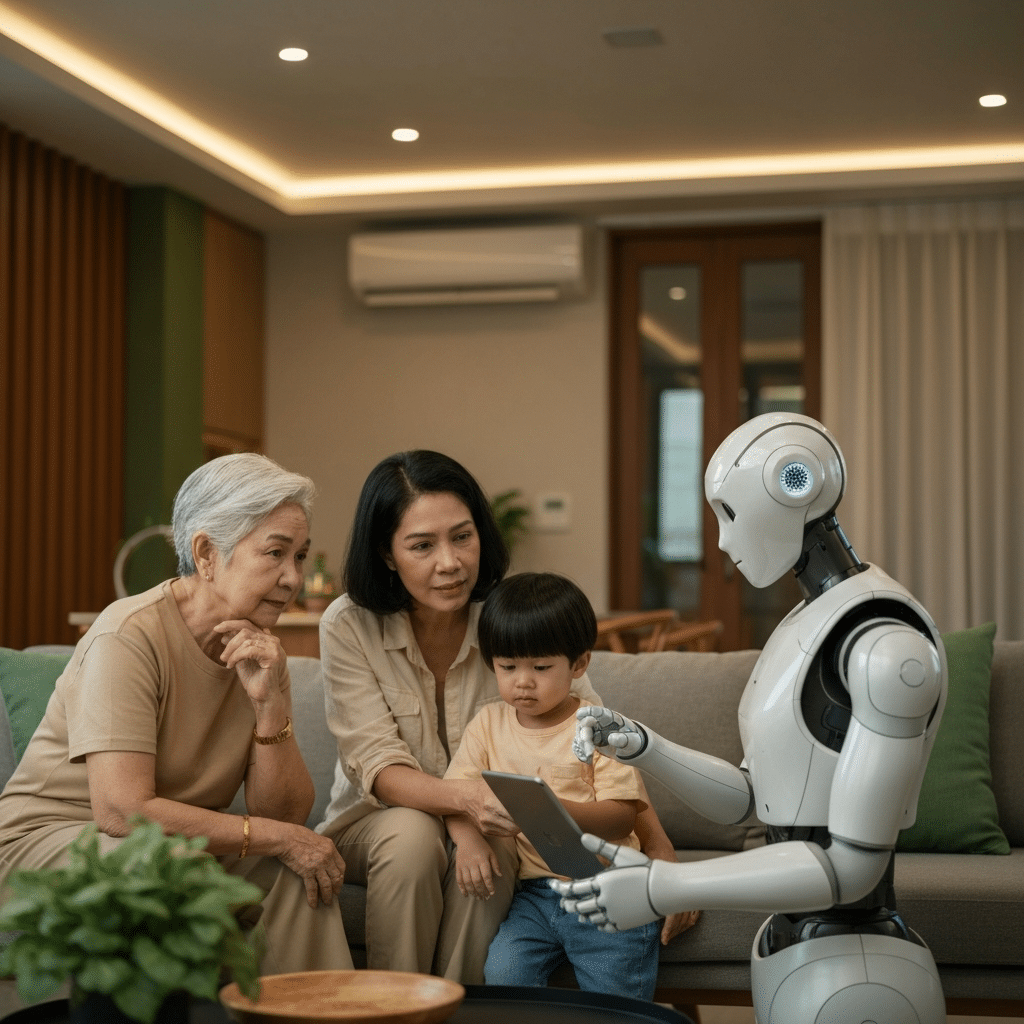

AI Companion หรือปัญญาประดิษฐ์ที่เป็นเพื่อนคู่คิดกำลังเข้ามามีบทบาทในชีวิตประจำวันมากขึ้น ตั้งแต่การเป็นผู้ช่วยเสมือนไปจนถึงหุ่นยนต์ดูแลผู้สูงอายุ การบูรณาการเทคโนโลยีนี้ทำให้เกิดคำถามสำคัญว่า AI Companion กฎหมายต้องไปทางไหน? สิทธิและความรับผิดชอบ ที่เกี่ยวข้องควรเป็นอย่างไร บทความนี้จะสำรวจกรอบกฎหมาย AI ของประเทศไทยที่กำลังพัฒนา สถานะทางกฎหมาย สิทธิ และความรับผิดชอบที่คาดว่าจะเกิดขึ้นในปี 2026 เพื่อสร้างความเข้าใจที่ชัดเจนต่อภูมิทัศน์ทางกฎหมายที่กำลังจะมาถึง

- ประเทศไทยกำลังพัฒนากฎหมาย AI แห่งชาติฉบับใหม่ โดยใช้โมเดลตามความเสี่ยง (Risk-Based Approach) ซึ่งได้รับอิทธิพลจากมาตรฐานสากลเช่น EU AI Act

- AI Companion ที่ประมวลผลข้อมูลส่วนบุคคลหรือมีผลต่อการตัดสินใจที่สำคัญ มีแนวโน้มจะถูกจัดอยู่ในกลุ่ม “AI ความเสี่ยงสูง” ซึ่งต้องปฏิบัติตามกฎระเบียบที่เข้มงวด

- ผู้ใช้งานจะได้รับสิทธิในการขอคำอธิบาย การตรวจสอบโดยมนุษย์ และการแจ้งเตือนเมื่อ AI สร้างผลกระทบเชิงลบ ขณะที่ผู้ให้บริการต้องรับผิดชอบต่อการกระทำของ AI

- ผู้ให้บริการ AI จากต่างประเทศจะต้องแต่งตั้งตัวแทนทางกฎหมายในประเทศไทยและจดทะเบียนกับหน่วยงานกำกับดูแล

- แม้ร่างกฎหมาย AI ฉบับสมบูรณ์ยังไม่ประกาศใช้ แต่ปัจจุบันการใช้ AI Companion ยังคงอยู่ภายใต้การกำกับดูแลของกฎหมายคุ้มครองข้อมูลส่วนบุคคล (PDPA) และกฎหมายอื่น ๆ ที่เกี่ยวข้อง

ภาพรวมกฎหมาย AI Companion ในประเทศไทย

ภูมิทัศน์ทางกฎหมายสำหรับเทคโนโลยีปัญญาประดิษฐ์ในประเทศไทยกำลังอยู่ในช่วงเปลี่ยนผ่านที่สำคัญ โดยมีเป้าหมายเพื่อสร้างสมดุลระหว่างการส่งเสริมนวัตกรรมและการคุ้มครองสิทธิของผู้บริโภค การพัฒนา AI Companion ซึ่งเป็นเทคโนโลยีที่โต้ตอบกับมนุษย์อย่างใกล้ชิดและจัดการข้อมูลส่วนบุคคล ถือเป็นตัวเร่งสำคัญที่ทำให้ภาครัฐต้องกำหนดกรอบการกำกับดูแลที่ชัดเจนและครอบคลุม

สถานการณ์ปัจจุบันและทิศทางในอนาคต

ในปัจจุบัน ประเทศไทยยังไม่มีกฎหมายที่กำกับดูแลปัญญาประดิษฐ์โดยตรง แต่การใช้งาน AI ที่เกี่ยวข้องกับข้อมูลส่วนบุคคลจะอยู่ภายใต้พระราชบัญญัติคุ้มครองข้อมูลส่วนบุคคล พ.ศ. 2562 (PDPA) อย่างไรก็ตาม แนวโน้มในอนาคตกำลังมุ่งหน้าสู่การมีกฎหมาย AI แห่งชาติฉบับแรก ซึ่งขณะนี้อยู่ระหว่างการพัฒนาโดยสำนักงานพัฒนาธุรกรรมทางอิเล็กทรอนิกส์ (สพธอ.) หรือ ETDA

ร่างกฎหมาย AI ฉบับนี้ได้รับแรงบันดาลใจจากมาตรฐานสากลที่สำคัญหลายฉบับ เช่น EU AI Act, ISO/IEC 42001:2023 และกรอบการทำงานของ NIST (National Institute of Standards and Technology) ของสหรัฐอเมริกา แต่จะมีการปรับแก้เพื่อให้สอดคล้องกับบริบททางสังคมและเศรษฐกิจของประเทศไทย กระบวนการพัฒนากฎหมายได้กลับมาเดินหน้าอีกครั้งในปี 2025 หลังจากหยุดชะงักไป โดยมีการเปิดรับฟังความคิดเห็นจากสาธารณชนผ่านศูนย์ธรรมาภิบาลปัญญาประดิษฐ์ (AI Governance Center: AIGC) และคาดว่าจะประกาศใช้ในอีกไม่กี่ปีข้างหน้า

นอกจากการร่างกฎหมายหลักแล้ว ยังมีการสนับสนุนนวัตกรรมผ่านโครงการ “Regulatory Sandbox” ซึ่งเป็นพื้นที่ทดลองให้นักพัฒนาสามารถทดสอบเทคโนโลยี AI ได้ภายใต้การกำกับดูแลอย่างใกล้ชิด รวมถึงมีการส่งเสริมการใช้ข้อมูลสาธารณะ (โดยได้รับอนุญาต) และสร้างกลไกคุ้มครอง (Safe Harbor) สำหรับกิจกรรมที่ดำเนินการโดยสุจริต เพื่อลดความเสี่ยงทางกฎหมายและกระตุ้นการพัฒนาเทคโนโลยีใหม่ๆ

โมเดลความเสี่ยง: หัวใจสำคัญของกฎหมายใหม่

หัวใจหลักของร่างกฎหมาย AI ฉบับใหม่ของไทยคือ “โมเดลตามระดับความเสี่ยง” (Risk-Based Approach) ซึ่งหมายความว่าระดับความเข้มงวดของการกำกับดูแลจะขึ้นอยู่กับระดับความเสี่ยงที่ AI นั้น ๆ อาจก่อให้เกิดต่อสิทธิและเสรีภาพของบุคคล โดยหน่วยงานกำกับดูแลจะเป็นผู้จำแนกประเภทของ AI ออกเป็นกลุ่มต่างๆ ดังนี้:

- AI ที่ถูกห้าม (Prohibited AI): คือระบบ AI ที่ถือว่ามีความเสี่ยงต่อสังคมสูงจนไม่สามารถยอมรับได้

- AI ความเสี่ยงสูง (High-Risk AI): คือระบบ AI ที่อาจส่งผลกระทบอย่างมีนัยสำคัญต่อสิทธิขั้นพื้นฐาน ความปลอดภัย หรือการตัดสินใจที่สำคัญของบุคคล เช่น ระบบที่ใช้ในการพิจารณาสินเชื่อ การจ้างงาน หรือการวินิจฉัยทางการแพทย์

- AI ความเสี่ยงต่ำ (Low-Risk AI): คือระบบ AI ที่มีความเสี่ยงน้อย เช่น แชทบอททั่วไปที่ให้ข้อมูลสาธารณะ

สำหรับ AI Companion มีแนวโน้มสูงที่จะถูกจัดอยู่ในกลุ่ม AI ความเสี่ยงสูง โดยเฉพาะอย่างยิ่งเมื่อมีการประมวลผลข้อมูลส่วนบุคคลที่ละเอียดอ่อน การโต้ตอบทางอารมณ์ หรือมีส่วนในการสร้างผลผูกพันทางกฎหมาย เช่น การทำสัญญา ซึ่งหมายความว่าผู้พัฒนาและผู้ให้บริการ AI Companion จะต้องปฏิบัติตามข้อกำหนดที่เข้มงวดเป็นพิเศษ

นอกจากนี้ กฎหมายยังเปิดช่องให้หน่วยงานกำกับดูแลในแต่ละภาคส่วน (Sector-specific Regulators) เช่น ธนาคารแห่งประเทศไทย หรือสำนักงานคณะกรรมการกำกับและส่งเสริมการประกอบธุรกิจประกันภัย (คปภ.) สามารถออกกฎระเบียบย่อยเพื่อกำกับดูแลการใช้ AI ในอุตสาหกรรมของตนเองได้ โดยมี AIGC ทำหน้าที่ประสานงานเพื่อให้การบังคับใช้กฎหมายเป็นไปในทิศทางเดียวกัน

สิทธิของผู้ใช้งานและผู้ให้บริการ AI Companion

เมื่อ AI Companion กลายเป็นส่วนหนึ่งของชีวิตประจำวัน การกำหนดสิทธิของผู้ใช้งานให้ชัดเจนจึงเป็นสิ่งสำคัญอย่างยิ่ง เพื่อสร้างความเชื่อมั่นและให้ความคุ้มครองแก่ประชาชน ในขณะเดียวกัน ผู้ให้บริการก็จำเป็นต้องทราบถึงขอบเขตการดำเนินงานที่กฎหมายอนุญาต เพื่อให้สามารถพัฒนานวัตกรรมได้อย่างต่อเนื่อง

สิทธิที่ผู้ใช้งานจะได้รับความคุ้มครอง

ภายใต้กรอบกฎหมาย AI ที่กำลังจะเกิดขึ้น ผู้ใช้งาน AI Companion จะได้รับสิทธิที่สำคัญหลายประการเพื่อคุ้มครองตนเองจากผลกระทบที่อาจเกิดขึ้น:

- สิทธิในการรับรู้และโปร่งใส (Right to Transparency): ผู้ใช้งานมีสิทธิที่จะรับทราบเมื่อกำลังโต้ตอบกับระบบ AI และต้องได้รับข้อมูลที่ชัดเจนเกี่ยวกับเหตุผลเบื้องหลังการตัดสินใจของ AI โดยเฉพาะอย่างยิ่งเมื่อการตัดสินใจนั้นส่งผลกระทบต่อตนเอง

- สิทธิในการขอคำอธิบายและการตรวจสอบโดยมนุษย์ (Right to Explanation and Human Review): หาก AI Companion ทำการตัดสินใจที่ส่งผลเสียต่อผู้ใช้งาน เช่น การปฏิเสธคำขอหรือการให้ข้อมูลที่ไม่ถูกต้อง ผู้ใช้งานมีสิทธิที่จะขอคำอธิบายและร้องขอให้มีการทบทวนการตัดสินใจนั้นโดยมนุษย์

- สิทธิในการได้รับการแจ้งเตือน (Right to Notification): ในกรณีที่เกิดผลกระทบเชิงลบจาก AI ผู้ให้บริการมีหน้าที่ต้องแจ้งให้ผู้ได้รับผลกระทบทราบถึงเหตุการณ์ที่เกิดขึ้น

- สิทธิในการได้รับการคุ้มครองจากข้อผิดพลาดที่คาดไม่ถึง: กฎหมายจะให้ความคุ้มครองผู้ใช้งานจากข้อผิดพลาดของ AI ที่ไม่สามารถคาดการณ์ได้อย่างสมเหตุสมผล ซึ่งหมายความว่าผู้ให้บริการไม่สามารถปัดความรับผิดชอบโดยอ้างว่า AI ทำงานผิดพลาดเองได้ง่ายๆ

- สิทธิในการรายงานความเสียหาย: ผู้ใช้งานที่ได้รับความเสียหายจากการใช้ AI เช่น การถูกหลอกลวง (Scams), การถูกสร้างข้อมูลปลอม (Deepfakes) หรือการละเมิดความเป็นส่วนตัว สามารถร้องเรียนไปยังหน่วยงานที่เกี่ยวข้อง เช่น ตำรวจไซเบอร์ หรือสำนักงานคณะกรรมการคุ้มครองข้อมูลส่วนบุคคล (สคส.)

การสร้างความโปร่งใสเป็นหัวใจสำคัญของกฎหมาย AI ผู้ใช้งานต้องรู้ว่ากำลังสื่อสารกับใครหรืออะไร และต้องสามารถเข้าถึงกระบวนการตัดสินใจของเทคโนโลยีที่ส่งผลต่อชีวิตของตนได้

การรับรองผลลัพธ์และการป้องกันการเลือกปฏิบัติ

ประเด็นสำคัญอีกประการหนึ่งคือการรับรองสถานะทางกฎหมายของผลลัพธ์ที่สร้างขึ้นโดย AI ร่างกฎหมายระบุว่าผลลัพธ์ที่เกิดจากการใช้ AI จะมีผลผูกพันทางกฎหมายได้ หากสามารถระบุได้ว่าการกระทำนั้นมาจากมนุษย์ผู้ใช้งานหรือผู้ควบคุม ตัวอย่างเช่น สัญญาที่ร่างและตกลงผ่าน AI Companion สามารถมีผลสมบูรณ์ได้ตามกฎหมาย

นอกจากนี้ กฎหมายยังได้วางหลักการสำคัญในการ “ห้ามการเลือกปฏิบัติ” (Non-discrimination) โดยระบุว่าจะไม่มีการปฏิเสธผลทางกฎหมายของการตัดสินใจเพียงเพราะว่าการตัดสินใจนั้นเกิดขึ้นโดยมี AI เป็นผู้ช่วย ซึ่งเป็นการส่งเสริมให้การนำเทคโนโลยี AI มาใช้ในกระบวนการต่างๆ เป็นที่ยอมรับและมีความน่าเชื่อถือทางกฎหมายมากขึ้น

ความรับผิดชอบทางกฎหมายของผู้พัฒนาและผู้ให้บริการ

ควบคู่ไปกับการให้สิทธิแก่ผู้ใช้งาน กฎหมายใหม่ยังกำหนดหน้าที่และความรับผิดชอบที่เข้มงวดสำหรับผู้พัฒนาและผู้ให้บริการ AI Companion โดยเฉพาะกลุ่มที่ถูกจัดว่าเป็น “ความเสี่ยงสูง” เพื่อให้แน่ใจว่าเทคโนโลยีจะถูกนำไปใช้อย่างปลอดภัยและมีธรรมาภิบาล

หน้าที่สำคัญสำหรับ AI Companion ที่มีความเสี่ยงสูง

ผู้ให้บริการ AI ที่มีความเสี่ยงสูง ซึ่งรวมถึง AI Companion ส่วนใหญ่ จะต้องปฏิบัติตามข้อกำหนดต่อไปนี้:

- การแต่งตั้งตัวแทนทางกฎหมายในประเทศ (Local Legal Representative): ผู้ให้บริการจากต่างประเทศที่ต้องการเสนอขายบริการ AI Companion ในประเทศไทย จะต้องแต่งตั้งตัวแทนทางกฎหมายที่มีถิ่นที่อยู่ในประเทศและทำการจดทะเบียนกับหน่วยงานกำกับดูแล เพื่อให้ง่ายต่อการติดต่อและบังคับใช้กฎหมาย

- การกำกับดูแลโดยมนุษย์และความรับผิดชอบ (Human Oversight and Accountability): หลักการสำคัญคือการกระทำของ AI จะต้องสามารถอ้างอิงกลับไปยังมนุษย์ผู้ควบคุมได้เสมอ ผู้ให้บริการไม่สามารถปฏิเสธความรับผิดชอบโดยอ้างว่า AI ทำงานนอกเหนือการควบคุมหรือคาดเดาไม่ได้

- การบริหารจัดการความเสี่ยง (Risk Management): ผู้ให้บริการต้องจัดทำระบบบริหารจัดการความเสี่ยงตามมาตรฐานสากล เช่น ISO หรือ NIST ซึ่งรวมถึงการเก็บบันทึกการทำงาน (Logs) การตรวจสอบความแม่นยำของระบบ และการจัดให้มีการตรวจสอบ (Audits) อย่างสม่ำเสมอ

- การรายงานเหตุการณ์ร้ายแรง (Incident Reporting): หากเกิดเหตุการณ์ร้ายแรงที่เกี่ยวข้องกับ AI ซึ่งส่งผลกระทบต่อผู้ใช้งานในวงกว้าง ผู้ให้บริการมีหน้าที่ต้องรายงานต่อหน่วยงานกำกับดูแลโดยทันที

- การปฏิบัติตามกฎหมาย PDPA: การประมวลผลข้อมูลส่วนบุคคลใดๆ โดย AI Companion จะต้องเป็นไปตามหลักการของ PDPA อย่างเคร่งครัด ทั้งในด้านฐานการประมวลผลข้อมูลและข้อตกลงการใช้งาน

การบังคับใช้กฎหมายและบทลงโทษ

เพื่อให้การกำกับดูแลมีประสิทธิภาพ ร่างกฎหมายได้ให้อำนาจแก่หน่วยงานกำกับดูแล เช่น AIGC และหน่วยงานเฉพาะทาง ในการใช้มาตรการบังคับใช้กฎหมายที่หลากหลาย หากพบว่ามีการฝ่าฝืนข้อกำหนด มาตรการเหล่านี้อาจรวมถึง:

- คำสั่งให้หยุดดำเนินการ (Stop Orders): สั่งให้ผู้ให้บริการระงับการให้บริการ AI ที่ไม่เป็นไปตามกฎหมายชั่วคราวหรือถาวร

- การปิดกั้นแพลตฟอร์ม (Platform Blocks): การสั่งระงับการเข้าถึงแพลตฟอร์มหรือแอปพลิเคชันที่เกี่ยวข้อง

- การยึดหรืออายัดระบบ (Seizures): ในกรณีที่ร้ายแรง อาจมีการยึดระบบคอมพิวเตอร์หรืออุปกรณ์ที่เกี่ยวข้อง

- การสั่งปิดกั้นโดยผู้ให้บริการอินเทอร์เน็ต (ISP Blocks): ประสานงานกับผู้ให้บริการอินเทอร์เน็ตเพื่อปิดกั้นการเข้าถึงบริการจากในประเทศ

มาตรการเหล่านี้แสดงให้เห็นถึงความจริงจังของภาครัฐในการสร้างสภาพแวดล้อมการใช้ AI ที่ปลอดภัยและน่าเชื่อถือสำหรับทุกคน

สรุปภาพรวมการกำกับดูแล AI Companion

ตารางด้านล่างนี้เปรียบเทียบภาพรวมของการกำกับดูแล AI Companion ภายใต้กรอบกฎหมายปัจจุบัน (PDPA) และร่างกฎหมาย AI ฉบับใหม่ที่จะเกิดขึ้นในอนาคต เพื่อให้เห็นภาพความแตกต่างและสิ่งที่ภาคธุรกิจต้องเตรียมพร้อม

| ประเด็นการกำกับดูแล | กฎหมายปัจจุบัน (PDPA/กฎหมายที่มีอยู่) | ร่างกฎหมาย AI (อนาคต) |

|---|---|---|

| ขอบเขตการบังคับใช้ | ครอบคลุมเฉพาะส่วนที่เกี่ยวข้องกับการประมวลผลข้อมูลส่วนบุคคลใน AI สำหรับผู้ให้บริการทุกราย | ใช้โมเดลตามความเสี่ยง กำหนดหน้าที่เข้มงวดสำหรับ AI ความเสี่ยงสูง เช่น AI Companion |

| หน้าที่หลักของผู้ให้บริการ | การปฏิบัติตามข้อกำหนดด้านการประมวลผลข้อมูลส่วนบุคคล | การกำกับดูแลโดยมนุษย์ การเก็บบันทึกข้อมูล (Logs) และการรายงานเหตุการณ์ร้ายแรง |

| ผู้ให้บริการจากต่างประเทศ | กฎหมาย PDPA มีผลบังคับใช้นอกอาณาเขต (Extraterritorial) | บังคับให้ต้องมีตัวแทนทางกฎหมายในประเทศและต้องจดทะเบียนกับหน่วยงานกำกับดูแล |

| บทลงโทษ | ค่าปรับภายใต้กฎหมาย PDPA และกฎหมายทรัพย์สินทางปัญญา | คำสั่งทางปกครอง เช่น คำสั่งให้ระงับบริการ การปิดกั้นแพลตฟอร์ม |

บทสรุปและการเตรียมความพร้อมสู่ยุค AI Companion

การเดินทางของประเทศไทยสู่การมีกฎหมายกำกับดูแล AI โดยเฉพาะกำลังเป็นรูปเป็นร่างขึ้นอย่างชัดเจน สำหรับคำถามที่ว่า AI Companion กฎหมายต้องไปทางไหน? สิทธิและความรับผิดชอบ จะถูกกำหนดอย่างไรนั้น คำตอบอยู่ที่การสร้างกรอบกฎหมายที่สมดุลบนพื้นฐานของความเสี่ยง ซึ่งจะกำหนดทั้งสิทธิที่ชัดเจนให้แก่ผู้ใช้งาน และความรับผิดชอบที่เข้มงวดให้แก่ผู้ให้บริการ เทคโนโลยีอย่าง AI Companion และหุ่นยนต์ดูแลผู้สูงอายุ ซึ่งมีแนวโน้มจะถูกจัดเป็น AI ความเสี่ยงสูง จะต้องเผชิญกับกฎระเบียบที่เคร่งครัดเป็นพิเศษ

แม้ว่าปัจจุบันจะยังไม่มีกฎหมาย AI ฉบับสมบูรณ์ แต่ภาคธุรกิจที่เกี่ยวข้องกับการพัฒนาหรือให้บริการ AI Companion ควรเริ่มเตรียมความพร้อมตั้งแต่บัดนี้ โดยให้ความสำคัญกับหลักการด้านความโปร่งใส การจัดทำระบบตรวจสอบ และการปฏิบัติตามกฎหมายคุ้มครองข้อมูลส่วนบุคคล (PDPA) อย่างเคร่งครัด เพราะหลักการเหล่านี้จะเป็นรากฐานสำคัญของกฎหมาย AI ที่จะเกิดขึ้นในอนาคต การเตรียมการล่วงหน้าไม่เพียงแต่จะช่วยลดความเสี่ยงทางกฎหมาย แต่ยังเป็นการสร้างความเชื่อมั่นให้กับผู้บริโภคและส่งเสริมระบบนิเวศของเทคโนโลยีปัญญาประดิษฐ์ให้เติบโตอย่างยั่งยืนและมีจริยธรรม